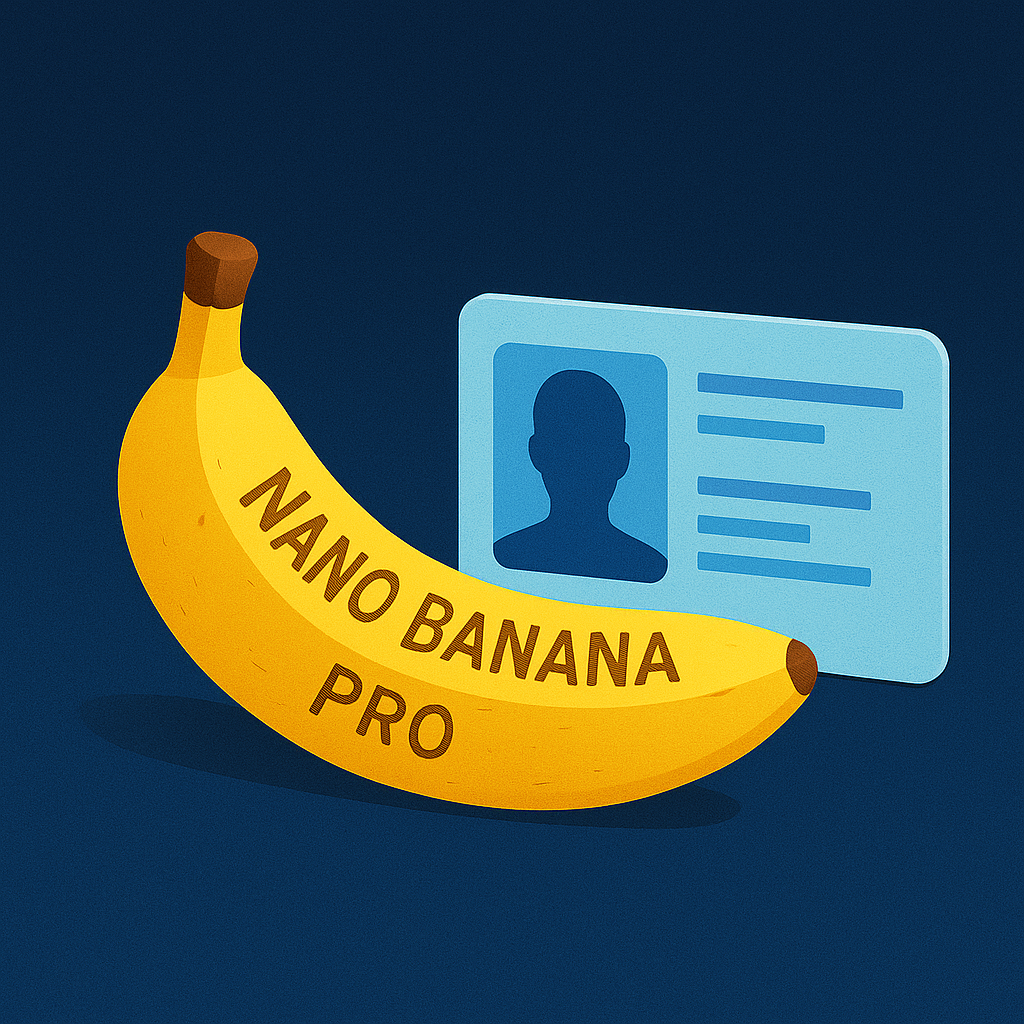

Η πρόσφατη αναφορά ότι το Google Nano Banana Pro μπορεί πλέον να παράγει εξαιρετικά ρεαλιστικά fake receipts, ψεύτικες KYC φωτογραφίες και passport-style έγγραφα με ένα και μόνο prompt, έχει προκαλέσει ιδιαίτερη ανησυχία στη διεθνή κοινότητα.

Αυτό που μέχρι χθες απαιτούσε υψηλή τεχνική γνώση, editing skills και εξειδικευμένα εργαλεία, σήμερα γίνεται σε δευτερόλεπτα. Και αυτό ακριβώς δημιουργεί το μεγαλύτερο ρίσκο.

Το πρόβλημα δεν είναι τα deepfakes ως τεχνολογία – είναι η ευκολία

Πλατφόρμες επαλήθευσης, marketplaces, εφαρμογές τραπεζών ή fintech, ακόμα και οργανισμοί που βασίζονται σε εικόνες για identity checks, βρίσκονται μπροστά σε μια νέα πραγματικότητα όπου:

- Οποιοσδήποτε μπορεί να δημιουργήσει «τεκμήρια» που μοιάζουν απόλυτα πραγματικά.

- Το layout, οι λεπτομέρειες και η συνολική αισθητική είναι τόσο ακριβείς που ξεγελούν ακόμη και ανθρώπους με εμπειρία.

- Η έννοια του “visual proof” καταρρέει.

Η εξέλιξη αυτή δεν αφορά μόνο το έγκλημα ή τα scams – αφορά την ίδια την εμπιστοσύνη που χτίστηκε τις δύο τελευταίες δεκαετίες στο διαδίκτυο.

Ποιοι απειλούνται;

- Marketplaces: πλαστά τιμολόγια / αποδείξεις για refunds

- Fintech και τράπεζες: fake KYC φωτογραφίες, λογαριασμοί, έγγραφα

- E-commerce: παραποιημένα έγγραφα για chargebacks ή εγγυήσεις

- Social platforms: bots που δημιουργούν δεκάδες ταυτότητες σε λίγα λεπτά

- Εταιρείες onboarding: verification συστήματα που πλέον δεν επαρκούν

Δεν είναι υπερβολή – πρόκειται για τον πρώτο μεγάλο σεισμό στο κομμάτι της ψηφιακής αυθεντικότητας.

Το κρίσιμο ερώτημα: Είναι έτοιμα τα verification systems;

Οι περισσότερες πλατφόρμες βασίζονται ακόμη σε διαδικασίες τύπου:

- “Ανέβασε φωτογραφία ταυτότητας”

- “Ανέβασε selfie για ταυτοποίηση”

- “Ανέβασε απόδειξη αγοράς”

Αν μια εικόνα μπορεί πλέον να δημιουργηθεί από AI σε 3 δευτερόλεπτα και να περάσει ως αυθεντική, τότε όλα αυτά χρειάζονται άμεσο επανασχεδιασμό.

Το AI δεν αμφισβητεί μόνο την έννοια της επαλήθευσης.

Την καταργεί στην παρούσα μορφή της.

Αλλά υπάρχει και η θετική πλευρά

Το AI δεν είναι ο «κίνδυνος».

Το AI είναι εργαλείο.

Ο τρόπος χρήσης του είναι ο πραγματικός κίνδυνος.

Οι επιχειρήσεις και οι πλατφόρμες πρέπει να κινηθούν άμεσα προς:

- AI-based detection systems

- Metadata verification

- Live digital signatures & dynamic watermarks

- Selfie-liveness checks

- Multi-factor verification πέρα από εικόνα

Αυτή είναι η αρχή του επόμενου κεφαλαίου στην ψηφιακή ασφάλεια.

Συμπέρασμα

Η τεχνολογία όπως το Nano Banana Pro δείχνει κάτι ξεκάθαρο:

Μπαίνουμε σε εποχή όπου τίποτα που “φαίνεται” δεν σημαίνει ότι είναι αληθινό.

Η συζήτηση πλέον δεν είναι αν το AI μπορεί να δημιουργεί ρεαλιστικά έγγραφα – το κάνει ήδη.

Η πραγματική συζήτηση είναι τι θα κάνουμε ως επιχειρήσεις, οργανισμοί και κοινωνία για να διατηρήσουμε την ψηφιακή εμπιστοσύνη.